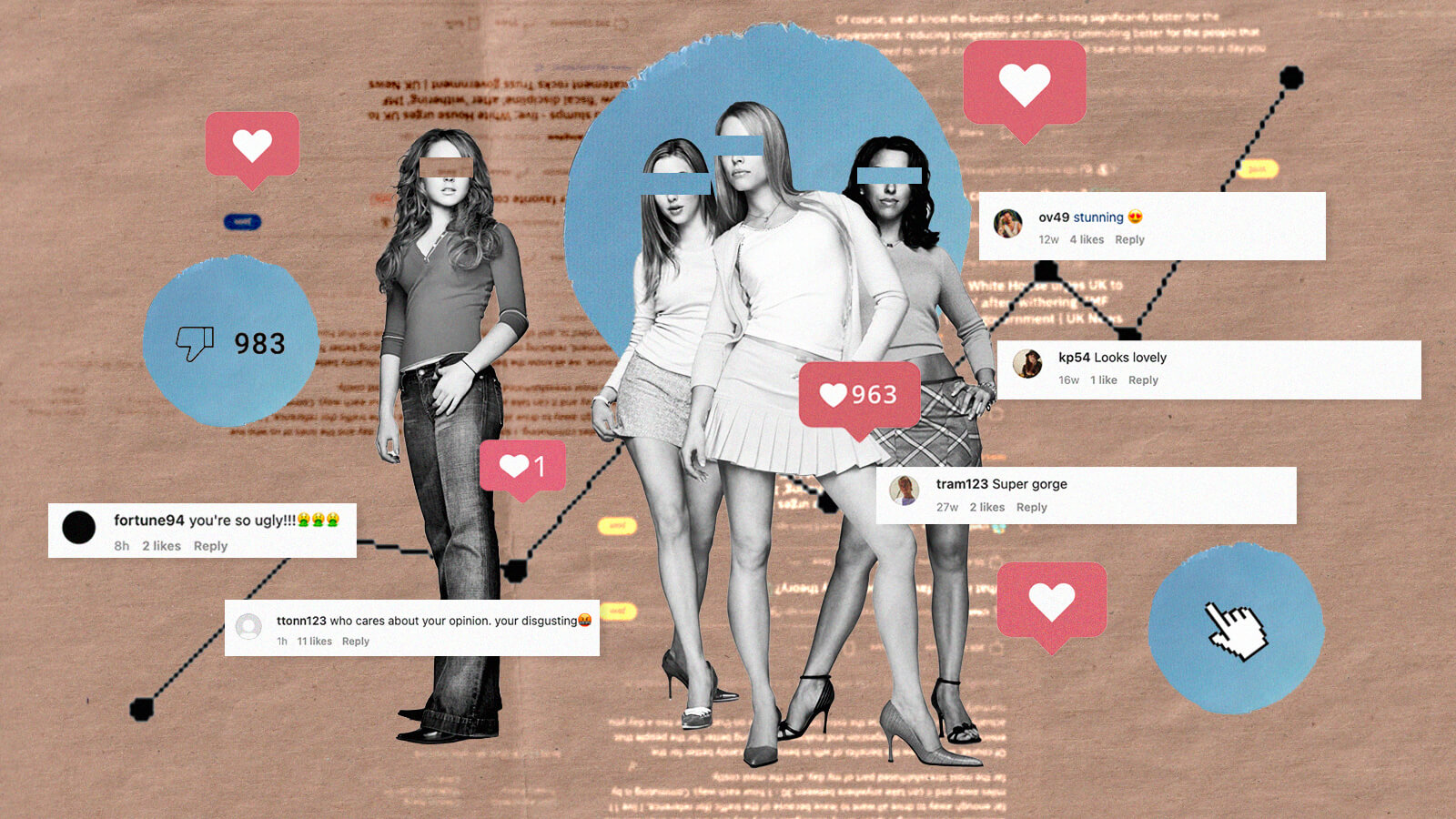

Toxisches Internet – ist der Algorithmus schuld?

Wenn das Internet der Film Girls Club – Vorsicht bissig! wäre, wären die sozialen Medien das Ekel Regina George. Der Vergleich passt. Die sozialen Medien leben von Skandalen, liefern uns permanent Klatsch und Tratsch und wissen genau, wie sie den Leuten suggerieren, wann sie uns meiden sollten. Doch das hier ist nicht bloß ein Film. Die sozialen Medien beeinflussen immer mehr die öffentliche Meinung, polarisieren, vertiefen politische Grabenkämpfe und fachen in schöner Regelmäßigkeit Misogynie, Rassismus und Intoleranz an. Aber wir sind es doch, die diese Plattformen füttern – schließlich melden wir uns freiwillig an und posten, was das Zeug hält. Ein Algorithmus alleine könnte uns doch nicht derart schikanieren. Oder doch?

Instagram von Meta enthielt sich eines Kommentars. Eine Stimme bei TikTok hingegen erteilte mir freudig Auskunft, dass sich bei Algorithmen alles um die Inhaltserstellung auf Basis von persönlichen Präferenzen drehe. Im Kern zeigt mir der Algorithmus also mehr von dem, was ich mag, und erfasst das anhand von Likes, abonnierten Accounts und abgespielten Videos. Auf den ersten Blick klingt das ganz praktisch, aber laufen wir bei genauerer Betrachtung nicht Gefahr, uns in Echokammern einzuschließen, wenn wir nur Inhalte vorgesetzt bekommen, die unserer eigenen Meinung entsprechen? Forciert das nicht die gesellschaftliche Spaltung?

Sara McCorquodale ist die Gründerin des Beratungsstudios Corq für soziale Medien und Autorin des Buchs Influence. Sie glaubt, dass soziale Medien zwar keine Spaltung anstreben, was aber nicht heißen soll, dass Spaltung diesen Plattformen nicht zum Vorteil gereicht. „Große Online-Communitys sind ein Sammelbecken für kontroverse Themen, und meiner Ansicht nach sind eine Menge Leute nahezu süchtig nach Reaktionen und der Bestätigung ihrer Meinung“, führt sie aus. „Die Sucht besteht darin, dass sie permanent Inhalte in den sozialen Medien konsumieren, was gut für diese Plattformen ist, wo sich alles um täglichen Konsum und Relevanz im Minutentakt dreht.“

Eines der Ziele des Algorithmus ist die Erfassung und Steigerung des Konsums, weil diese Plattformen damit ihr Geld verdienen – je länger die User online sind, desto mehr Werbung bekommen sie präsentiert, und wenn der Algorithmus herausfindet, was gut funktioniert, liefert er mehr davon. Dabei muss das nicht unbedingt etwas sein, wonach die User gezielt gesucht haben, sondern kann auch einfach ein aktuelles Thema sein. Das erklärt vielleicht, warum diesen Sommer so viele Beiträge gegen Amber Heard ungefragt in unsere Feeds gespült wurden.

„Kritische Posts werden eher kommentiert und geteilt als andere“, sagt Camille Carlton, Senior Policy and Communications Manager am Centre for Humane Technology – einer gemeinnützigen Organisation, die mit ihrer Arbeit Technik mehr in die soziale Verantwortung nehmen will. „Moralisch aufgeladene Worte in Nachrichten steigerten die Verbreitung um 20 % – pro Wort. Solange Hass gut funktioniert, zahlt er sich aus, und solange sich Hetze auszahlt, besteht für diese Plattformen keine Veranlassung, sie uns vorzuenthalten.“

Hetzkampagnen sind der Lebenssaft des Internets. Nehmen wir einfach das erste Opfer von Online-Mobbing: Monica Lewinsky, die letzte Woche bei unserem Podcast At Your Service zu Gast war. Ihre Affäre mit dem damaligen US-Präsidenten Bill Clinton im Jahr 1998 war der erste politische Skandal, der online Wellen schlug. Das war die Geburtsstunde von Klatschseiten im Internet, auf denen wir durch die Demütigung von Berühmtheiten unsere niedersten Interessen befriedigen können. Soziale Medien haben uns da reingezogen und geben uns die Möglichkeit, beim Mobben mitzumachen. Sie ködern uns mit Sensationslust. „Der Algorithmus erfasst oft die Beschäftigung mit Inhalten, die nicht unbedingt dem entsprechen, was uns wirklich interessiert oder guttut“, bestätigt Carlton. Das ist wie bei einem Autounfall. „Wir können einfach nicht wegsehen.“

Die Stimme bei TikTok erzählt mir jedoch, dass Nutzer*innen aktiv bestimmen können, was sie nicht sehen möchten – durch Sperren bestimmter Hashtags oder Accounts. „Dafür müssen die Leute proaktiv mit sozialen Medien umgehen, statt nur passiv zu scrollen, was sich an diesem Punkt wohl eher unnatürlich anfühlt“, meint McCorquodale. „Das ist außerdem die einzige Möglichkeit, Echokammern zu unterbinden: sich selbst zu zwingen, mit politischem und thematischem Content zu interagieren, um einen ausgewogeneren, nuancierten Feed zu erhalten.“ Bedeutet das also, wer dem keinen Riegel vorschiebt, ist nur ein willenloser Mobber? „Nein, wir haben es mit einem System zu tun, das von einigen der brillantesten Köpfe entwickelt wurde, um uns bei der Stange zu halten“, sagt Carlton.

Das funktioniert so wie bei einer Lebensmittelallergie. Mein Kühlschrank verhält sich in diesem Vergleich wie der Algorithmus: Sobald ich ihn öffne, füttert er mich mit genau dem Essen, auf das ich allergisch bin. Wenn ich etwas davon herunterschlucke, füttert mich mein Kühlschrank beim nächsten Mal wieder damit. Der Algorithmus erzeugt keine Hassinhalte, und technisch gesehen zwingt er uns auch nicht, sie uns anzusehen, aber genauso wie bei der hinterlistigen Regina George ist sein Einfluss alles …

Marie-Claire Chappet ist eine in London ansässige Kunst- und Kulturjournalistin und mitwirkende Redakteurin bei der Harper‘s Bazaar.