O maior bully das mídias sociais é o próprio algoritmo?

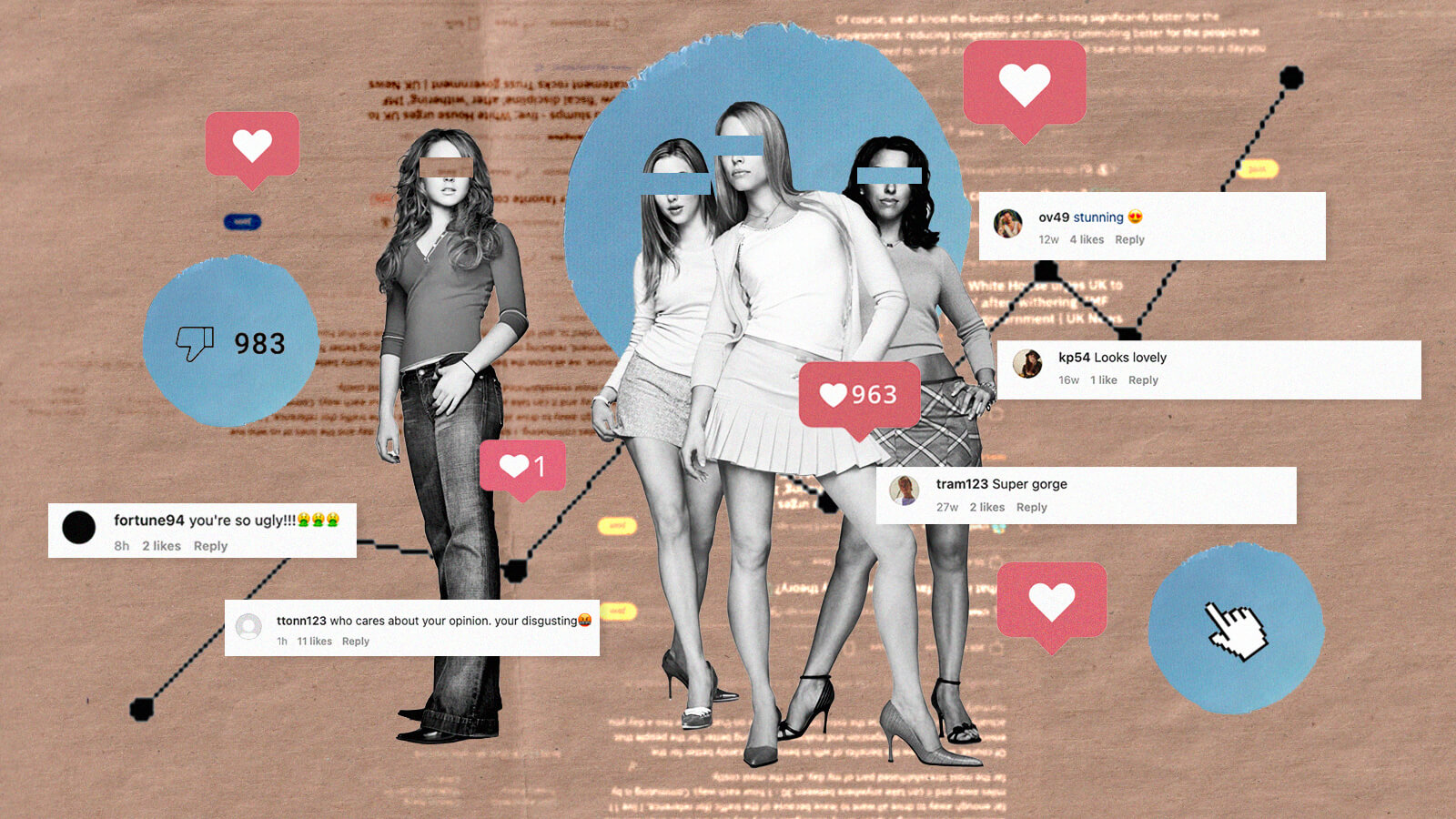

Se o mundo online fosse o filme Meninas Malvadas, as redes sociais seriam Regina George. Uma bully. Faz sentido. Elas vivem de escândalos, nos alimentam com fofocas constantes e são especialistas em dizer quando as pessoas são ou não são bem-vindas. Mas claro que não estamos no filme Meninas Malvadas. As redes sociais estão moldando cada vez mais a opinião pública, consolidando a polarização política e fortalecendo a misoginia, o racismo e a intolerância. No entanto, essas plataformas são alimentadas por nós, que voluntariamente nos engajamos com elas. Isoladamente, um algoritmo não poderia nos intimidar. Ou poderia?

Embora o Instagram, da Meta, tenha se recusado a comentar, um porta-voz do TikTok me disse abertamente que o algoritmo deles seleciona conteúdo com base nas preferências do usuário. Basicamente, ele mostra mais coisas que você gosta. Para descobrir isso, ele usa as curtidas, os seguidores e os vídeos que você assiste. Parece útil, mas considere o seguinte: ao ver apenas coisas que nos interessam, mergulhamos cada vez mais fundo na “câmara do eco ideológico”, contribuindo para a crescente divisão da sociedade.

Sara McCorquodale, fundadora da consultoria de redes sociais Corq e autora do livro Influence, acredita que, embora a divisão não seja o objetivo das mídias sociais, ela beneficia essas plataformas. “Enormes comunidades online se unem em torno de questões divisivas, e acho que uma quantidade substancial de pessoas é viciada em obter reações e ter suas opiniões validadas”, diz ela. “O vício de se envolver exageradamente com conteúdo social é uma vantagem para as redes, com destaque para o uso diário e a relevância minuto a minuto”.

O objetivo de um algoritmo é medir e aumentar o engajamento, porque é assim que essas plataformas são monetizadas: quanto mais tempo você passa nelas, mais publicidade elas direcionam a você e, ao descobrir o que funciona, podem servir mais do mesmo. Não precisa ser algo que você pesquisou – pode ser apenas uma tendência. Isso explica por que o conteúdo contra a Amber Heard chegou sem ser convidado aos nossos feeds nos últimos meses.

“As críticas são mais propensas a receber comentários e compartilhamentos do que outras postagens”, diz Camille Carlton, gerente sênior de políticas e comunicações do Center for Humane Technology, uma organização sem fins lucrativos que trabalha para tornar a tecnologia mais socialmente responsável. “Palavras moralmente emocionais aumentam a difusão da mensagem em 20% para cada palavra adicional. Enquanto o ódio tiver um bom desempenho, ele é lucrativo, e enquanto a indignação for lucrativa, as plataformas não têm incentivo para desencorajá-la.”

A indignação é a alma da internet. Basta olhar para a primeira vítima do bullying online: a convidada do podcast At Your Service da semana passada, Monica Lewinsky. Em 1998, seu caso com o presidente Bill Clinton foi o primeiro escândalo político a ser divulgado online. Os sites de fofocas nasceram em seguida, e as pessoas os acessavam para alimentar o interesse primitivo pela indignidade de pessoas famosas. A mídia social se aproveitou desse fenômeno, nos dando a opção de participar do bullying e nos atraindo para o que chamo de “ataque aos nossos olhos”. “O algoritmo mede o engajamento com conteúdo que não é necessariamente do seu interesse ou bom para você”, concorda Camille. “São coisas das quais você não consegue desviar o olhar.”

No entanto, o porta-voz do TikTok contou que os usuários podem dizer ativamente o que não querem ver – filtrando hashtags ou determinados usuários. “Isso exige que as pessoas adotem uma abordagem proativa às mídias sociais, em vez de simplesmente rolar passivamente pela tela, o que pode parecer antinatural”, observa Sara McCorquodale. Essa também é a única maneira de combater as câmaras de eco, forçando-nos a interagir com conteúdo de todo tipo e espectro político para obter um feed mais equilibrado e matizado.” Então, se podemos impedir isso, será que somos apenas bullies sem força de vontade? “Não, estamos enfrentando um sistema criado por mentes brilhantes para tentar nos manter engajados”, diz Camille.

Funciona assim: se você fosse alérgico a um determinado tipo de comida e sua geladeira se comportasse como o algoritmo, ela enfiaria essa comida na sua boca quando você a abrisse. Se você mordesse algo, ela enfiaria o dobro da quantidade da próxima vez. O algoritmo não cria conteúdo de ódio e, tecnicamente, não nos obriga a assisti-lo, mas assim como a traiçoeira Regina George, sua influência é tudo…

Marie-Claire Chappet é jornalista de arte e cultura, editora colaboradora da Harper’s Bazaar e mora em Londres